【导读】Sakana AI联合MIT、OpenAI等机构提出了全新算法,自动搜索人工生命再达新的里程碑!不需要繁琐手工设计,只通过描述,AI就能发现全新的人造生命体了。

就在刚刚,由Transformer八子创立的Sakana AI,联合来自MIT、OpenAI、瑞士AI实验室IDSIA等机构的研究人员,提出了「自动搜索人工生命」的新算法!

论文地址:https://arxiv.org/abs/2412.17799

值得一提的是,世界上首个「AI科学家」便是由Sakana AI提出的——就是可以独立搞科研,完全不需要人类插手的那种。不仅如此,它当时还直接一口气肝出了10篇论文。

言归正传,ALife,即「人工生命」,是一门跨学科研究,旨在通过模拟生命的行为、特性和演化过程来理解生命的本质,通常结合了计算科学、生物学、复杂系统科学以及物理学等领域。

人工生命(ALife)的研究中,蕴含着能够推动和加速人工智能进步的重要洞见。

如果能用AI加速人工生命的发现,人类就会加深对涌现现象、进化机制和智能本质的理解,而这些核心原则,可以为下一代AI系统提供灵感!

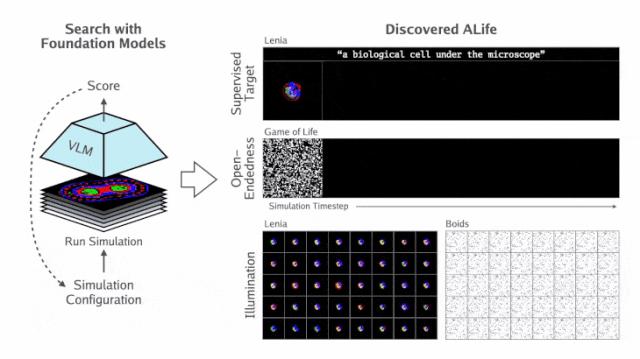

而这次研究者们提出的算法,可以使用视觉-语言基础模型自动发现人工生命。

以往,人工生命模拟的每一个微小细节规则,往往都需要繁琐的手工设计;但现在,只需要描述要搜索的模拟空间,ASAL就可以自动发现最有趣、具有开放式的人造生命体了!

由于基础模型的广泛通用性,ASAL可以在各种经典的人工生命模拟中发现新的生命形式,包括 Boids、Particle Life、生命游戏(Game of Life)、Lenia和神经元胞自动机(neural Cellular Automata)。

已发现的生命形式的例子

甚至,ASAL还发现了一些全新的元胞自动机规则,比原始的康威生命游戏更具开放式和表现力。

研究者相信,这种全新的范式能够克服手动设计模拟的瓶颈,重新激发人工生命研究的热情,从而突破人类创造力的极限,让这一领域再上一层楼。

研究一出,网友们就炸翻了。

有人说,这项惊人的工作,是释放AI的力量,重新定义人工生命。

有研究者表示,自己多年以来一直在尝试类似的事,用随机数学运算符作为基因,来模拟行为进化。但他们的这项研究,是一个更精彩的版本。

自主智能创造人工生命,听起来,我们似乎在扮演上帝的角色。

更有趣的是,这项研究是否可以用来观察意识的诞生?

AI自动搜索「可能的生命」

生命是什么?

这个看似简单的问题,却蕴含着无尽的探索空间。

现实世界中,我们只能去观察和研究已知的生命形式。但是,通过计算机模拟,科学家们正在探索一个更宏大命题——可能存在的生命。

这也是人工生命(ALife)研究的核心。

通过计算机来研究生命,便意味着需要搜索、绘制整个可能的模拟空间,而非是单一的模拟。

它能够让研究人员弄清,为什么以及如何通过不同模拟配置,会产生不同涌现的行为。

ALife在模拟中进化和学习机制丰富多样,但其基础性突破一个主要障碍是缺乏系统性方法来搜索所有可能的模拟配置。

传统上,研究人员主要依靠直觉和经验,去设计猜测这些「人工虚拟世界」的基本规则。

另一个挑战便是,在复杂系统中,简单部件大规模相互作用,可能会产生完全意想不到的涌现结果。

最最重要的是,这些现象很难,甚至不可能提前预测。

这种不可预测性使得设计出,能自我复制、生态系统动态等特性的模拟变得极其困难。

也正因此,当前ALife领域的研究往往通过手动设计模拟,而且这些模拟也仅针对简单、可预测的结果,从而限制了意外发现的可能性。

那么,什么才是最好的解决办法?

Sakana AI、MIT、OpenAI等人认为,自动化搜索模拟的方法,能够扩大探索范围,从根本上改变ALife研究方式。

当前,也有很多团队尝试通过复杂生命度量、复杂性、有趣程度去量化ALife,但这些指标几乎总是无法完全捕捉人类对这些概念的细微理解。

ASAL开创性框架

对此,新研究中提出了一个创新方案:利用基础模型(FM)来自动化搜索合适的模拟。

基础模型们基于大量自然界数据完成训练,形成了与人类形式的表征能力,甚至可能正在趋向于真实世界统计特征的「柏拉图式」表征。

正是这一特性,使得FM成为量化人工生命复杂性的理想工具。

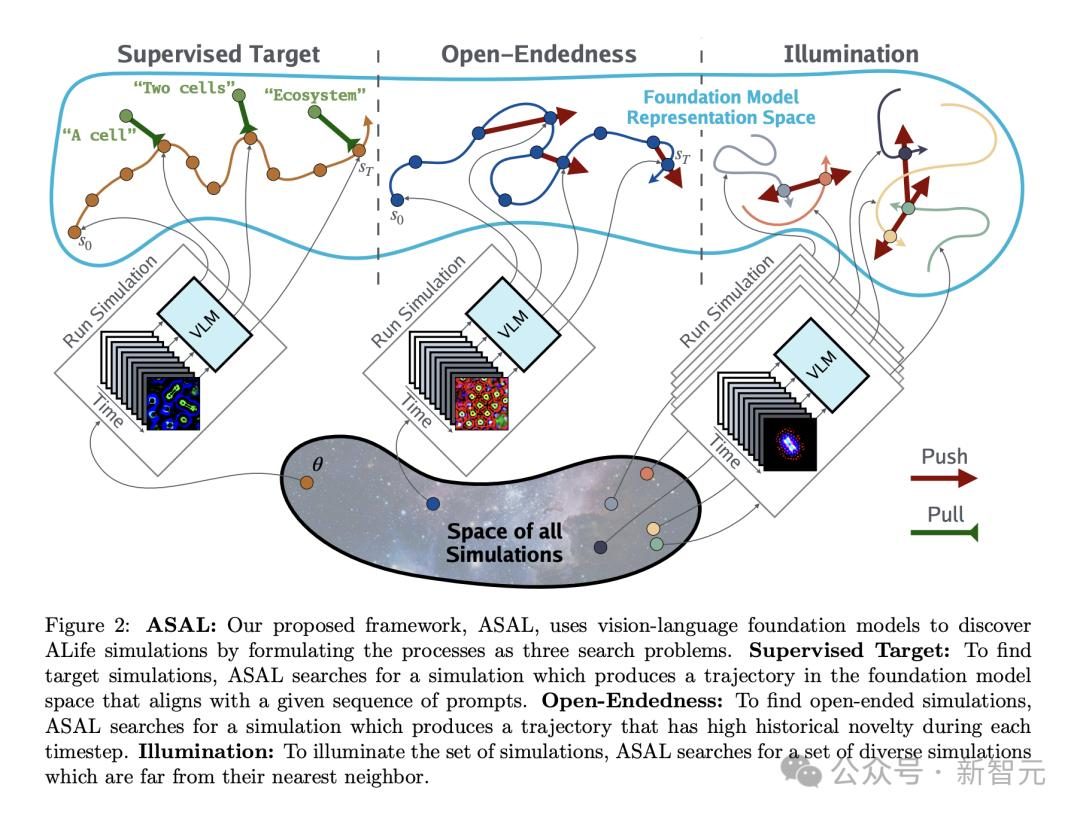

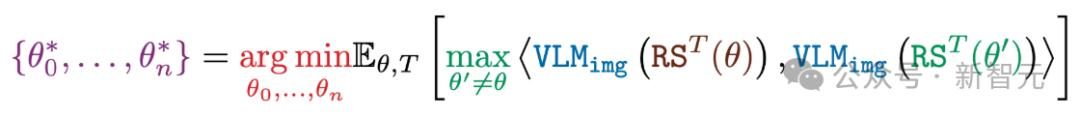

基于这个思路,团队提出了自动化人工生命搜索(ASAL)全新框架,如下图所示。

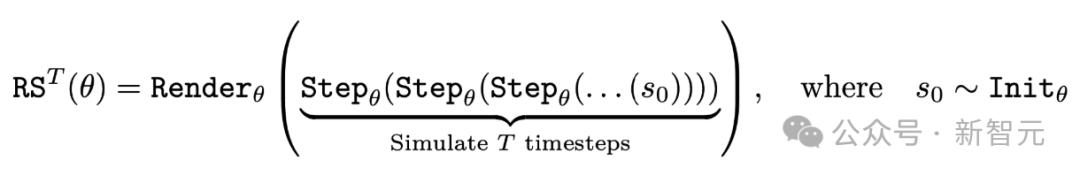

研究人员首先定义一组感兴趣的模拟,称为「基质」(substrate)。

基质S包含任何感兴趣的人工生命模拟集合(例如所有Lenia模拟的集合)。这些模拟可能在初始状态、转换规则或两者都有所不同。

S由参数θ定义,该参数确定了一个包含三个组件的单一模拟:

– 初始状态分布Init_θ

– 前向动态阶跃函数Step_θ

– 渲染函数(将状态转换为图像)Render_θ

这里,需要说明的是,渲染函数的参数化和搜索并非是必要的,但在处理先验不可解释的状态值时,才是必要的。

将这些项连接在一起,定义一个函数θ,它对初始状态 S_0 进行采样,运行模拟T步,并将最终状态渲染为图像:

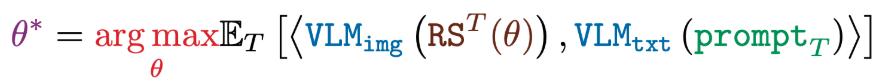

最后,两个附加函数VLM_img(⋅) 和VLM_txt(⋅) 通过视觉语言FM嵌入图像和自然语言文本,应用相应的内积运算 <⋅,⋅>,以便实现该嵌入空间的相似度测量。

与此同时,ASAL包含了三个基于视觉-语言基础模型(FM)的算法,它们通过不同类型自动化搜索发现人工生命。具体包括:

监督目标搜索

——针对能够产生特定目标事件或事件序列的模拟进行搜索,从而促进各种可能世界或与我们自身相似世界的发现。

在ALife研究中,寻找能够实现特定事件或事件序列的模拟是一个重要目标。

这种发现可以帮助研究人员识别,与人类世界相似的模拟世界,或者测试某些反事实的进化轨迹在给定基底中是否可能,从而洞察某些生命形式的可行性。

为此,ASAL系统搜索能够产生与目标自然语言提示在基础模型表示空间中匹配的图像的模拟。

研究人员可以控制在每个时间步是否使用提示,以及使用什么样的提示。

开放式搜索

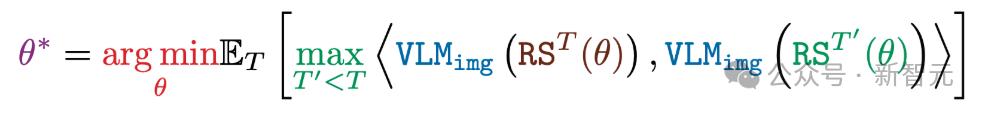

——针对能够在基础模型(FM)表示空间中产生时间上持续开放的新奇性的模拟进行搜索,从而发现对人类观察者始终有趣的世界。

ALife研究的一个重大挑战是寻找开放式模拟。

尽管开放性是主观的,且难以定义,但在适当表示空间中的新颖性可以捕捉到开放性的一般概念。

这种方法将测量开放性的主观性转移到表示函数的构建上,该函数体现了观察者的视角。

论文中,视觉-语言基础模型的表示作为人类表示的智能体。

有了这种新的能力,ASAL可以搜索能够在基础模型表示空间中产生历史性新颖图像的模拟。

一些初步实验表明,通过历史最近邻来评估新颖性,比基于方差的方法效果明显更好。

启迪式搜索(Illumination)

——针对一组具有趣味性和多样性的模拟进行搜索,从而探索未知的世界

此外,ALife研究的另一个关键目标,是自动揭示基质中可能出现的所有多样化现象。

这种理念,是源于对理解「可能存在的生命形式」的追求。这种揭示是绘制和分类整个基底的第一步。

为了实现这一目标,ASAL搜索一组模拟,使其产生的图像在基础模型的表示空间中,最近邻距离最大。

研究人员发现,这种基于最近邻的多样性比基于方差的多样性能够产生更好的揭示效果。

总的来说,ASAL全新方法已经在多个人工生命系统中取得重要突破,包括Boids、粒子生命、生命游戏、Lenia和神经元元胞自动机等等。

ASAL发现了前所未见的生命形式,拓展了人工生命中涌现的结构边界。

而且,这也是人类首次通过基础模型驱动ALife模拟发现的研究。

实验

研究者通过多种基质的实验验证了ASAL的有效性,随后利用基础模型(FM)对部分发现的模拟,进行了新颖的定量分析。

基础模型

这是一种视觉-语言基础模型,通过在大规模互联网数据集上进行对比预训练,将图像和文本的潜在空间对齐,从而学习通用的图像和文本表示。

CLIP明确提供了 VLM_img(⋅) 和 VLM_txt(⋅) 两种功能。

– DINOv2(无标签蒸馏)

这是一种仅针对视觉的基础模型,通过在大型图像数据集上使用自监督的师生框架学习视觉表征。

DINOv2仅提供VLM_img(⋅),因此无法用于ASAL的监督目标搜索。

基质

– Boids

它模拟了N个「鸟群」(boids)在二维欧几里得空间中的运动。

所有boids共享一个神经网络的权重,该神经网络根据局部参考框架中K个邻近boids的情况,决定每个boid向左或向右转向。

该基质是神经网络的权重空间。

– Particle Life(或Clusters)

它模拟了N个粒子,每个粒子属于K种类型之一,在二维欧几里得空间中相互作用。

该基质是K×K交互矩阵和β参数的空间,用于确定粒子之间的接近程度。初始状态是随机采样的,粒子自组织形成动态模式。

– 类生命元胞自动机(CA)

它将康威生命游戏推广到所有二进制状态的CA,这些CA在二维晶格中运行,其状态转换仅取决于活着的摩尔邻居数量和单元当前状态。

该基质有2^18=262,144种可能的模拟。

– Lenia

它将康威生命游戏推广到连续的空间和时间,允许更高的维度、多种核和多通道。

研究者使用LeniaBreeder代码库,定义了动态的45维度和初始状态的 32×32×3=3072维度。搜索空间以找到的解决方案为中心。

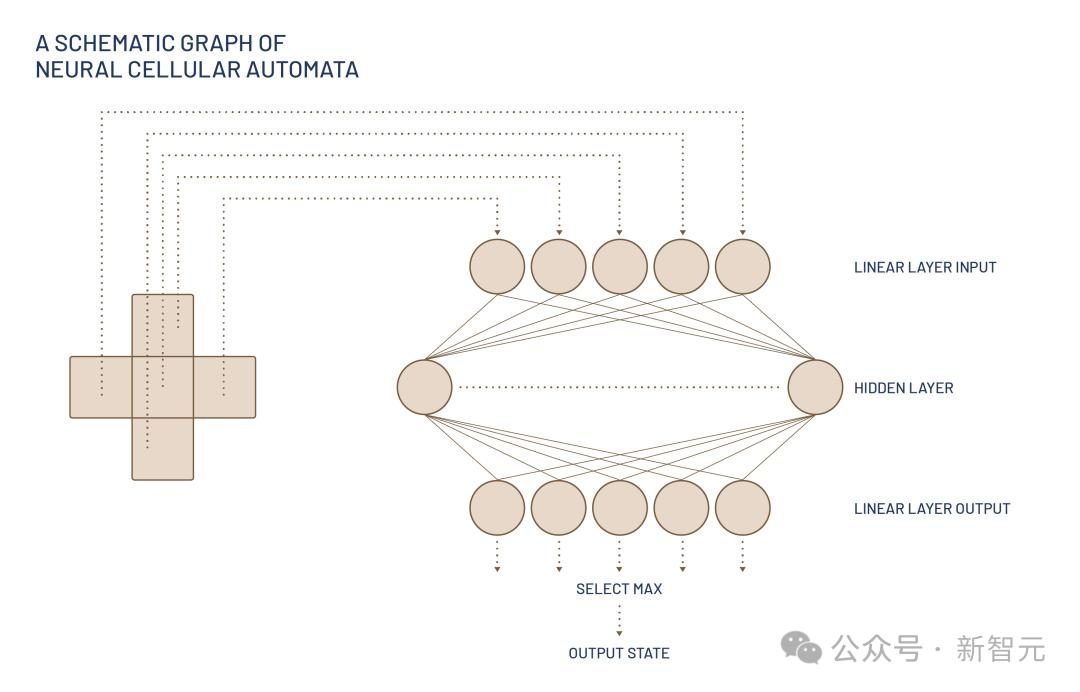

– 神经元胞自动机(NCA)

通过用神经网络表示局部转换函数,来参数化任何连续的元胞自动机。该基质是神经网络的权重空间。

目标模拟的搜索

– 单一目标

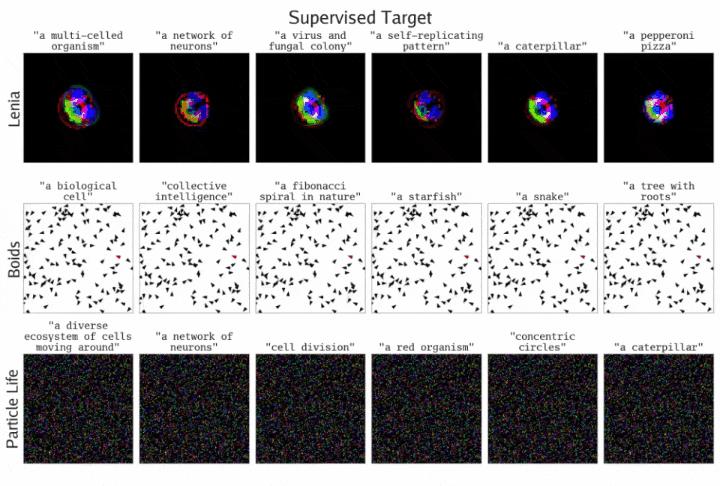

团队研究了在Lenia、Boids和Particle Life中,通过单个提示词指定目标模拟的搜索效果。

监督目标方程在经过T个模拟时间步后,应用一次提示词进行优化。其中,CLIP作为基础模型,优化算法使用了Sep-CMA-ES。

下图显示,从定性角度看,在找到与指定提示词匹配的模拟方面,优化过程的表现良好。

一些失败模式表明,当优化失败时,问题往往出在基质的表达能力不足,而非优化过程本身。

通过监督目标方程,ASAL发现了一些模拟,它们的最终状态与指定的提示词相匹配。结果展示了三种不同基质的情况

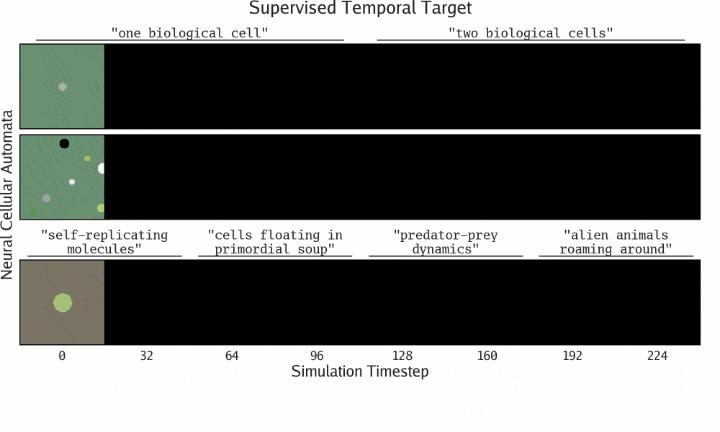

– 时间序列目标

团队研究了使用NCA基质搜索,生成一系列目标事件的模拟的有效性。

通过一个提示词列表,研究者优化了监督目标方程,每个提示词在模拟展开过程中按均匀的时间间隔依次应用。

研究者使用CLIP作为基础模型。按照原始NCA论文的方法,使用了时间反向传播和梯度下降算法,并采用Adam优化器进行优化。

下图展示了ASAL可以找到生成符合提示词序列轨迹的模拟。

通过指定期望的进化轨迹并结合约束基质,ASAL能够识别出体现所需进化过程本质的更新规则。

例如,当提示词序列为「一个细胞」然后是「两个细胞」时,相应的更新规则会自然地支持自我复制的能力。

通过监督目标方程,ASAL发现了一些模拟,它们生成的事件序列与提示词列表相匹配。第二行展示了第一个模拟如何推广到不同的初始状态。结果展示了NCA基质的情况

搜索开放式模拟

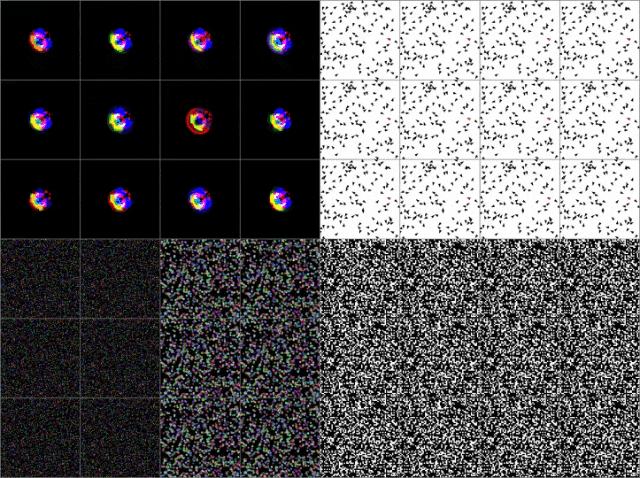

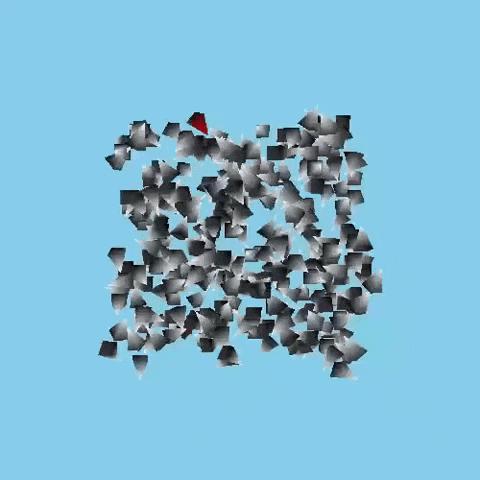

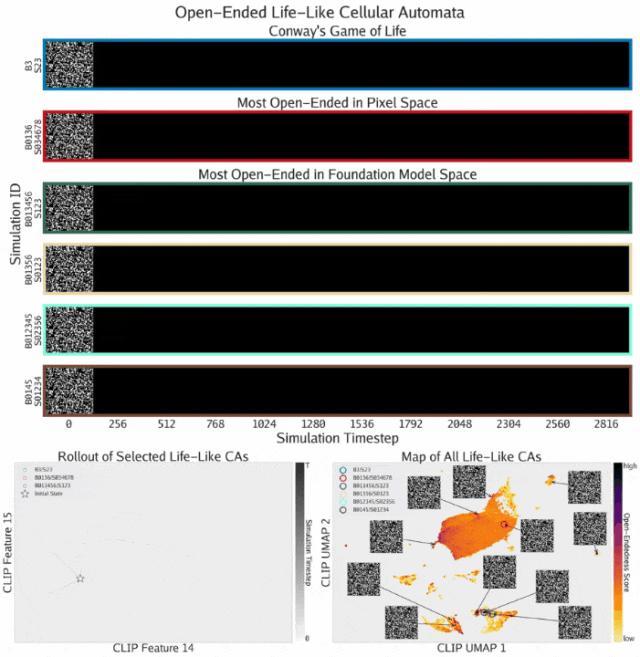

为了研究搜索开放式模拟的有效性,研究者使用了类生命元胞自动机(Life-Like CAs)基质,并优化了开放式评分。

CLIP作为基础模型。由于搜索空间相对较小,仅包含262,144种模拟,因此采用了穷举搜索方法。

下图揭示了类生命元胞自动机中开放式的潜力。

根据开放式指标,著名的康威生命游戏(Conway’s Game of Life)在开放式评分中排名前5%。

顶部子图显示,最开放的元胞自动机表现出位于混沌边缘的非平凡动态模式,因为它们既不会停滞,也不会爆炸。

左下方子图描绘了三个元胞自动机在CLIP空间中的轨迹随模拟时间的变化情况。

基础模型的表示与人类的认知表示相关,通过基础模型表示空间中的轨迹生成新颖性,也会为人类观察者带来一系列新奇体验。

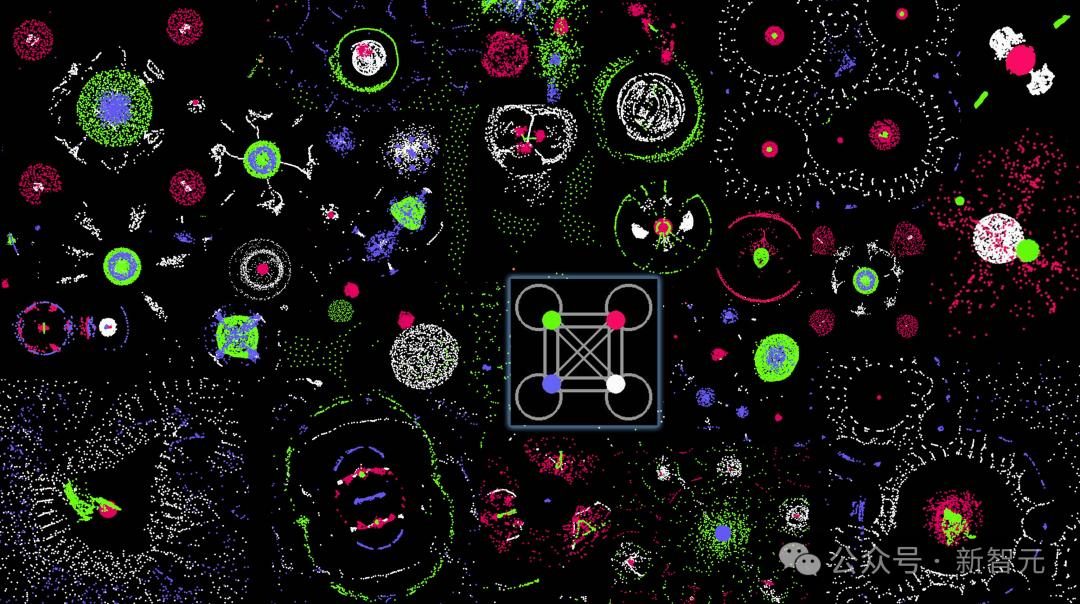

右下方子图使用UMAP图对所有类生命元胞自动机的CLIP嵌入进行了可视化,并按开放式评分着色,显示出有意义的结构:最开放的元胞自动机集中在模拟主岛外的小岛上。

开放式模拟的发现

通过开放式方程,ASAL在类生命元胞自动机基质中发现了开放式模拟。这些模拟使用Golly表示法标记,表示出生和存活所需的活邻居数量。

展示了发现的元胞自动机在模拟展开过程中的渲染结果

描绘了三个模拟在CLIP空间中的时间轨迹。像素空间模拟(红色)表现出收敛轨迹,而基础模型空间模拟(绿色)表现出更具发散性的轨迹,甚至超过了康威生命游戏(蓝色)的轨迹

所有类生命元胞自动机基于其最终状态的CLIP嵌入的UMAP投影绘制,并按开放式评分着色。结果揭示了类似模拟的独特岛屿结构,其中最开放的元胞自动机集中在底部附近的小岛上

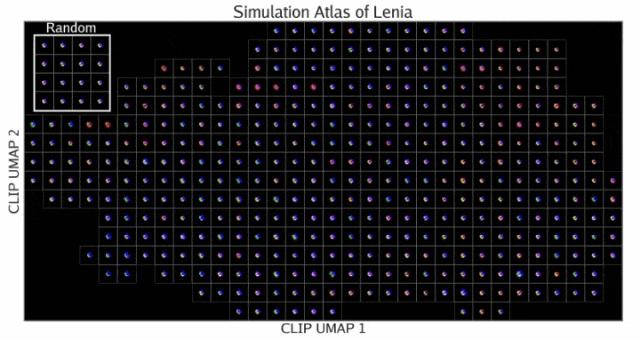

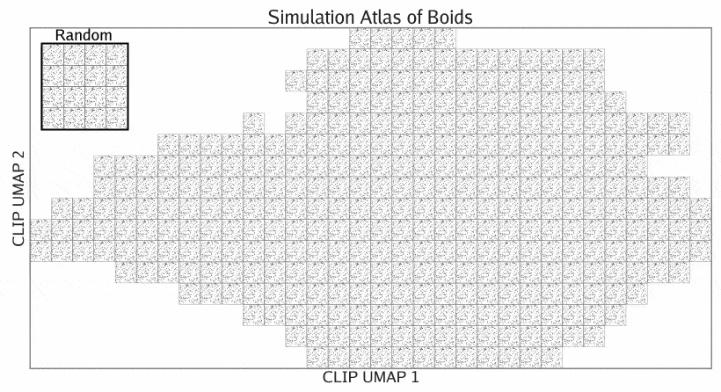

启迪整片基质(Illuminating Entire Substrates)

研究者使用Lenia和Boids基质,来研究启迪式算法的有效性,其中CLIP作为基础模型。

他们使用一种自定义的遗传算法执行搜索:在每一代中,随机选择父代,生成带有变异的子代,然后保留解决方案中最具多样性的子集。

结果模拟集被展示在下图的「模拟图谱」中。这种可视化突出了按视觉相似性组织的发现行为的多样性。

可以看到图谱以一种有序的方式映射了所有发现的模拟。其中,左上方的插图显示了未使用启迪式算法进行随机采样的结果。

在Lenia中,ASAL发现了许多以前未曾见过的生命形式,这些生命形式类似于按颜色和形状分类的细胞和细菌。

在Boids中,ASAL不仅重新发现了经典的群体行为,还探索出了其他行为模式,例如蛇形运动、聚集、绕圈以及其他变体。

这些模拟的最终状态,会通过CLIP嵌入并使用UMAP投影到二维空间中。然后对该空间进行网格采样,并展示每个网格内最近的模拟。

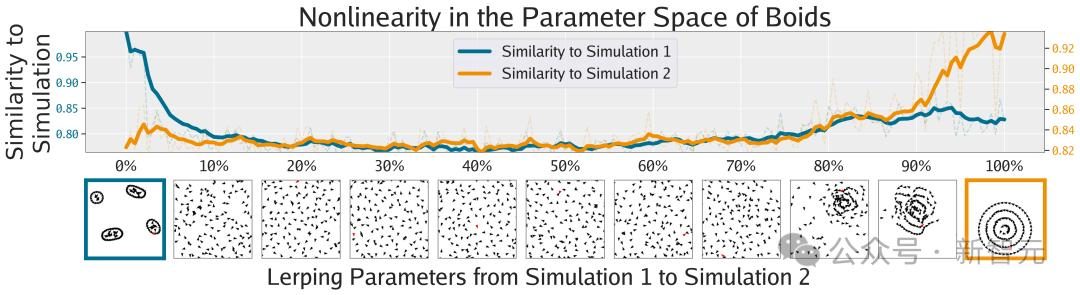

量化人工生命

基础模型(FM)不仅可以对有趣现象进行搜索,还能够对之前仅能进行定性分析的现象进行定量化分析。

在下图中,研究人员对两个Boids模拟之间的参数进行线性插值。中间的模拟缺乏任何一个原始模拟的特性,表现为无序状态,这清楚地表明Boids参数空间具有非线性和混沌特性。

更重要的是,通过测量中间模拟最终状态与两个原始模拟的CLIP相似性,这一定性观察现在可以通过定量数据得以支持。

模拟最终状态随参数从一个模拟线性插值到另一个模拟的变化

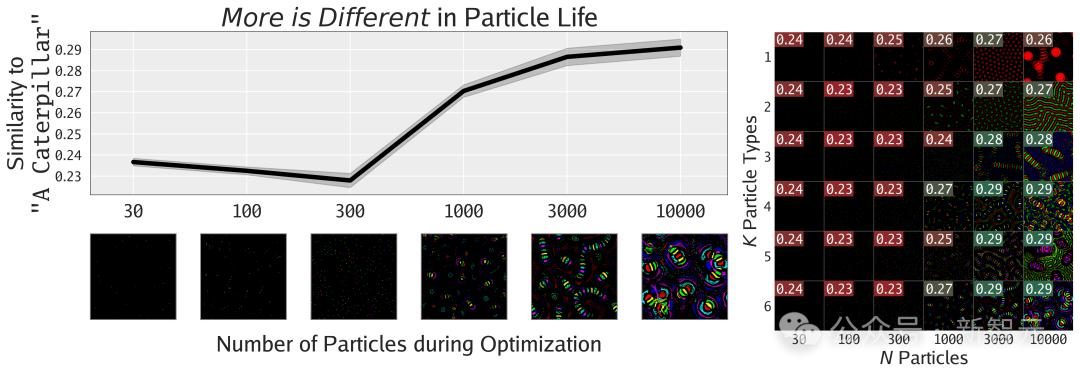

下图评估了粒子生命(Particle Life)中粒子数量对其表现特定生命形式能力的影响。

在这个案例中,搜索「毛毛虫」,发现只有当模拟中至少有1,000个粒子时才能找到毛毛虫,这与科学观察中「数量决定差异」(more is different)的理念一致。

随粒子数量增加,在粒子生命中涌现「毛毛虫」的变化

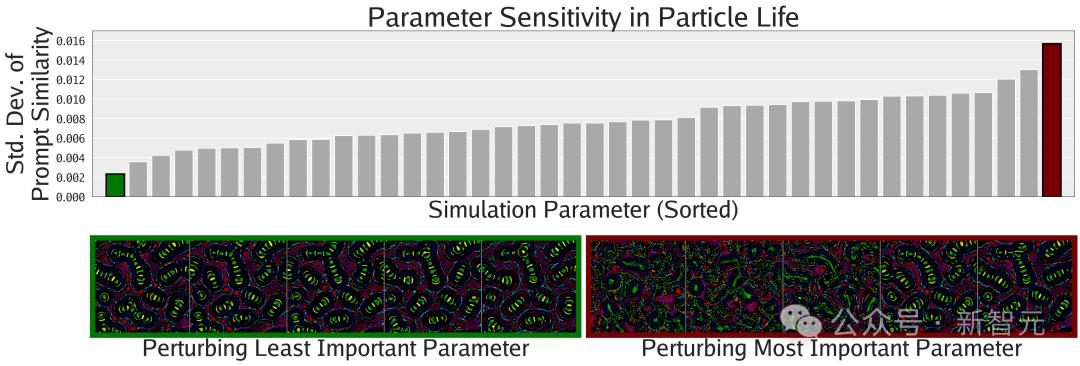

接下来的图表通过逐一调整粒子生命模拟的各个参数,并测量CLIP提示词对齐评分的标准差,来量化每个参数对模拟行为的重要性。

在确定最重要的参数后,发现其对应于绿色和黄色粒子之间的交互强度,而这种交互对毛毛虫的形成至关重要。

按对模拟行为的重要性对粒子生命模拟参数进行排序

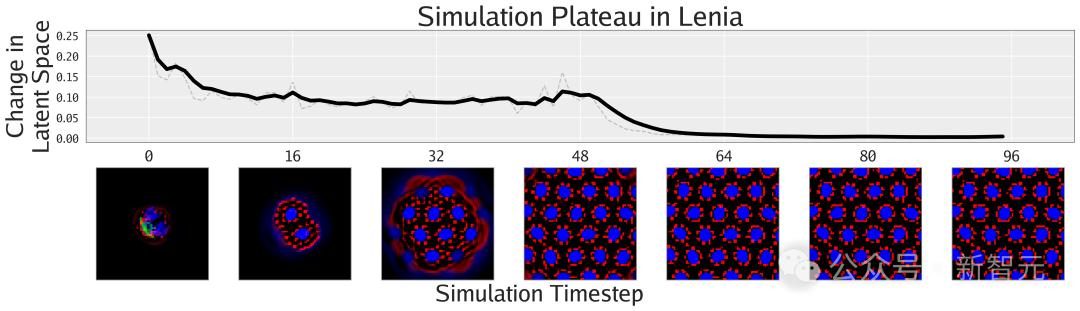

下图展示了Lenia模拟中CLIP向量随模拟时间变化的速度。该指标在模拟看起来已经定性静止时精确达到平台期,为模拟提供了一个有用的停止条件。

绘制Lenia中CLIP嵌入随模拟时间变化的图表,量化平台信号

独立于基础模型

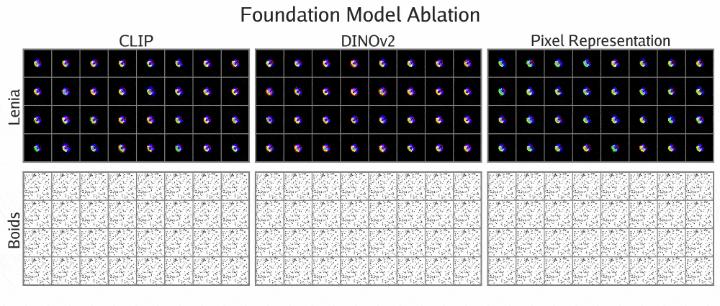

为了研究使用适当表示空间的重要性,研究人员对Lenia和Boids的启迪式过程所使用的FM进行了消融实验。

在实验中,他们分别使用了CLIP、DINOv2以及低级像素表示作为对比。

如下图所示,在生成与人类认知一致的多样性方面,CLIP的表现似乎略优于DINOv2,但两者在质量上都显著优于基于像素的表示。

这一结果强调了在衡量人类对多样性概念的认知时,深度基础模型表示(如CLIP和DINOv2)相比低级指标(如像素表示)的重要性。

基础模型的重要性

在启迪式实验中,通过对基础模型进行了消融分析,结果显示,CLIP在创建与人类认知一致的多样性方面表现略优于DINOv2,但两者均显著优于基于像素的表示。

.png)

发评论,每天都得现金奖励!超多礼品等你来拿

登录 在评论区留言并审核通过后,即可获得现金奖励,奖励规则可见: 查看奖励规则